Żyjemy w erze, w której generatywna sztuczna inteligencja (GenAI) – jak np: ChatGPT – staje się nieodłącznym narzędziem w niemal każdej dziedzinie nauki. Modele językowe, takie jak te oparte na architekturze GPT, oferują niespotykane dotąd możliwości w zakresie przetwarzania i generowania tekstu, analizy danych, a nawet twórczego pisania. Jednak aby w pełni wykorzystać potencjał tych narzędzi, kluczowa jest umiejętność inżynierii podpowiedzi (prompt engineering). Nie jest to już tylko domena informatyków – to kompetencja interdyscyplinarna, równie ważna dla humanisty, socjologa, biologa, jak i inżyniera.

Czym jest Inżynieria Podpowiedzi?

Inżynieria podpowiedzi to sztuka i nauka formułowania instrukcji (podpowiedzi, ang. prompts) dla modeli językowych w taki sposób, aby uzyskać pożądane rezultaty. Nie chodzi tylko o zadanie pytania – to proces projektowania interakcji z AI, który wymaga zrozumienia, jak model „myśli” i przetwarza informacje. Dobrze skonstruowana podpowiedź to precyzyjny wektor sterujący, który prowadzi model do generowania odpowiedzi zgodnych z naszymi oczekiwaniami.

Dlaczego to ważne dla Doktorantów?

- Przyspieszenie badań: AI może pomóc w przeglądzie literatury, analizie danych, generowaniu hipotez, a nawet w pisaniu fragmentów pracy.

- Nowe perspektywy: Interakcja z AI może zainspirować do nieszablonowego myślenia i odkrywania nowych powiązań między danymi.

- Wsparcie w komunikacji naukowej: AI może pomóc w redagowaniu tekstów, tworzeniu prezentacji, a nawet w przygotowywaniu odpowiedzi na pytania recenzentów.

- Rozwój kompetencji przyszłości: Umiejętność efektywnej komunikacji z AI to kluczowa kompetencja w XXI wieku, niezależnie od dyscypliny.

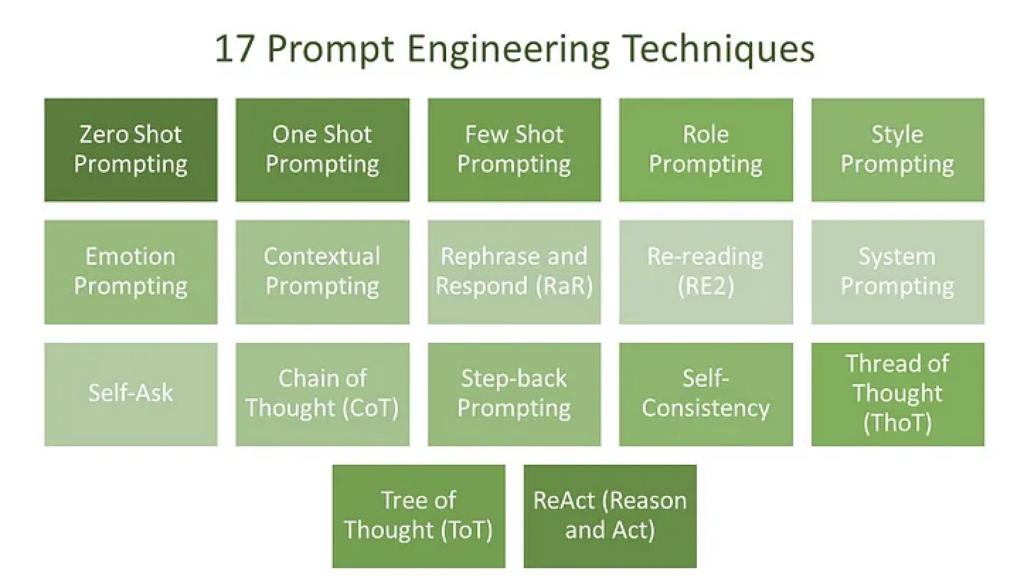

17 Technik Inżynierii Podpowiedzi – Przewodnik dla Doktorantów (z przykładami):

Przyjrzyjmy się 17 technikom inżynierii podpowiedzi, przedstawionym na grafice, którą załączyliście, i omówmy je w kontekście pracy doktoranta:

- Zero-Shot Prompting: Zadajemy pytanie lub wydajemy polecenie bez podawania przykładów.

- Przykład (dla historyka): „Opisz główne przyczyny wybuchu rewolucji francuskiej.”

- Zastosowanie: Szybkie uzyskanie ogólnych informacji, generowanie pomysłów.

- Zalety: prostota i szybkie tworzenie promptu

- Wady: odpowiedź może być nieprecyzyjna

- One-Shot Prompting: Podajemy jeden przykład, aby ukierunkować model.

- Przykład (dla biologa): „Mutacja w genie BRCA1 zwiększa ryzyko raka piersi. Opisz wpływ mutacji w genie TP53 na rozwój nowotworów.”

- Zastosowanie: Precyzowanie odpowiedzi, gdy oczekujemy określonego formatu lub stylu.

- Zalety: lepsza kontrola i dokładniejsza odpowiedź w porównaniu do techniki Zero-Shot

- Wady: Potrzeba co najmniej jednego przykładu

- Few-Shot Prompting: Podajemy kilka przykładów, aby jeszcze lepiej wytrenować model in-context.

- Przykład (dla socjologa):

Pytanie: Jakie są skutki urbanizacji dla środowiska? Odpowiedź: Zanieczyszczenie powietrza, utrata bioróżnorodności, zwiększone zużycie energii. Pytanie: Jakie są skutki globalizacji dla lokalnych kultur? Odpowiedź: Homogenizacja kultury, utrata tradycji, konflikty kulturowe. Pytanie: Jakie są skutki automatyzacji dla rynku pracy? - Zastosowanie: Uzyskiwanie spójnych i precyzyjnych odpowiedzi, szczególnie w przypadku złożonych zadań.

- Zalety: model „uczy się” na podstawie przykładów, co poprawia jakość i trafność odpowiedzi.

- Wady: Konieczność podania większej liczby przykładów.

- Przykład (dla socjologa):

- Role Prompting: Przypisujemy modelowi określoną rolę, aby wpłynąć na styl i treść odpowiedzi.

- Przykład (dla każdego): „Jesteś doświadczonym profesorem uniwersyteckim. Wyjaśnij …”

- Zastosowanie: Uzyskiwanie odpowiedzi dostosowanych do określonego odbiorcy lub celu.

- Zalety: Możliwość dostosowania stylu i tonu wypowiedzi.

- Wady: Model może „przesadzić” z odgrywaniem roli.

- Style Prompting: Określamy pożądany styl wypowiedzi.

- Przykład: „Napisz w stylu naukowym, zwięźle i precyzyjnie, …”

- Zastosowanie: Uzyskiwanie tekstów o określonej estetyce i tonie.

- Zalety: kontrola nad formą wypowiedzi

- Wady: Model może nie w pełni zrozumieć subtelności stylu

- Emotion Prompting: Dodajemy do podpowiedzi element emocjonalny, aby wpłynąć na wydźwięk odpowiedzi.

- Przykład: „Z entuzjazmem opisz korzyści płynące z …”

- Zastosowanie: (Ostrożnie!) Może być użyteczne w komunikacji naukowej, np. w pisaniu listów motywacyjnych.

- Zalety: Potencjalnie większe zaangażowanie odbiorcy.

- Wady: Ryzyko nienaturalności, nieprzewidywalność.

- Contextual Prompting: Podajemy kontekst, w którym ma być osadzona odpowiedź.

- Przykład (dla politologa): „W kontekście rosnącej polaryzacji politycznej w USA, omów …”

- Zastosowanie: Precyzowanie zakresu odpowiedzi, unikanie niejednoznaczności.

- Zalety: Odpowiedź jest lepiej dopasowana do kontekstu.

- Wady: Wymaga starannego określenia kontekstu.

- Rephrase and Respond (RaR): Prosimy model o przeformułowanie pytania, a następnie o odpowiedź.

- Przykład: „Przeformułuj to pytanie, a następnie na nie odpowiedz: ‚Jakie są etyczne implikacje edycji genów?'”

- Zastosowanie: Upewnienie się, że model dobrze zrozumiał pytanie, uzyskanie różnych perspektyw.

- Zalety: lepsze zrozumienie pytania przez model, potencjalnie bogatsza odpowiedź.

- Wady: Dłuższy czas przetwarzania.

- Re-reading (RE2): Prosimy model o ponowne przeczytanie i analizę własnej odpowiedzi.

- Przykład: „Przeanalizuj krytycznie swoją poprzednią odpowiedź. Czy jest ona wystarczająco precyzyjna? Czy uwzględnia wszystkie istotne aspekty?”

- Zastosowanie: Poprawianie jakości i spójności odpowiedzi, wykrywanie błędów.

- Zalety: Poprawa jakości i rzetelności odpowiedzi.

- Wady: Wymaga dodatkowego czasu i zasobów.

- System Prompting: Podajemy instrukcje dotyczące działania modelu.

- Przykład: „Odpowiadaj zwięźle, używając punktów. Nie przekraczaj 200 słów.”

- Zastosowanie: Kontrolowanie formatu i długości odpowiedzi.

- Zalety: pełna kontrola nad formą.

- Wady: brak

- Self-Ask: Prosimy model o zadanie sobie dodatkowych pytań, zanim odpowie na główne pytanie.

- Przykład: „Zanim odpowiesz, zadaj sobie trzy pytania pomocnicze, które pomogą ci lepiej zrozumieć problem.”

- Zastosowanie: Pogłębianie analizy, uzyskiwanie bardziej kompleksowych odpowiedzi.

- Zalety: Bardziej pogłębiona analiza problemu.

- Wady: Znacznie dłuższy czas przetwarzania.

- Chain of Thought (CoT): Prosimy model o opisanie krok po kroku procesu myślowego, który doprowadził do odpowiedzi.

- Przykład: „Wyjaśnij krok po kroku, jak doszedłeś do tego wniosku.”

- Zastosowanie: Zrozumienie logiki modelu, identyfikacja potencjalnych błędów w rozumowaniu.

- Zalety: Lepsze zrozumienie procesu myślowego modelu.

- Wady: Dłuższe odpowiedzi, nie zawsze przydatne w prostych zadaniach.

- Step-back Prompting: Prosimy model o cofnięcie się i rozważenie szerszego kontekstu problemu.

- Przykład: „Zanim odpowiesz, rozważ szerszy kontekst historyczny i społeczny tego zagadnienia.”

- Zastosowanie: Uzyskiwanie bardziej holistycznych i kontekstualnych odpowiedzi.

- Zalety: Odpowiedź uwzględnia szerszy kontekst.

- Wady: Może prowadzić do nadmiernego uogólnienia.

- Self-Consistency: Prosimy model o wygenerowanie kilku odpowiedzi, a następnie o wybranie najbardziej spójnej.

- Przykład: „Wygeneruj trzy różne odpowiedzi na to pytanie, a następnie wybierz tę, która jest najbardziej spójna i logiczna.”

- Zastosowanie: Weryfikacja wiarygodności odpowiedzi, wybór najlepszego rozwiązania.

- Zalety: Większa pewność co do poprawności odpowiedzi.

- Wady: Znacznie dłuższy czas przetwarzania.

- Thread of Thought (ThoT): Rozwijamy interakcję z modelem w formie „nici” myślowej, zadając kolejne pytania w oparciu o poprzednie odpowiedzi.

- Przykład: Kontynuujemy dialog z modelem, zadając pytania doprecyzowujące i rozwijające wątki poruszone w poprzednich odpowiedziach.

- Zastosowanie: Prowadzenie pogłębionej dyskusji z modelem, eksploracja złożonych zagadnień.

- Zalety: Interaktywna i dynamiczna eksploracja tematu.

- Wady: Wymaga aktywnego zaangażowania i starannego formułowania pytań.

- Tree of Thoughts (ToT): Prosimy model o rozważenie różnych ścieżek rozumowania i przedstawienie ich w formie drzewa.

- Przykład: „Przedstaw różne możliwe scenariusze rozwoju sytuacji, uwzględniając różne czynniki i ich wpływ.”

- Zastosowanie: Analiza złożonych problemów decyzyjnych, planowanie strategiczne.

- Zalety: Umożliwia rozważenie wielu alternatywnych rozwiązań.

- Wady: Złożoność i czasochłonność.

- ReAct (Reason and Act): Łączymy rozumowanie (reasoning) z działaniem (acting), prosząc model o uzasadnienie swoich decyzji i podjęcie konkretnych kroków.

- Przykład: „Uzasadnij, dlaczego wybrałeś tę metodę badawczą, a następnie opisz, jak ją zastosujesz.”

- Zastosowanie: Projektowanie eksperymentów, rozwiązywanie problemów praktycznych.

- Zalety: Połączenie myślenia i działania.

- Wady: Złożoność i ryzyko błędów.

Podsumowanie i Dalsze Kroki:

Inżynieria podpowiedzi to dynamicznie rozwijająca się dziedzina. Powyższe techniki to tylko punkt wyjścia. Zachęcam Was do eksperymentowania, łączenia różnych podejść i tworzenia własnych, unikalnych strategii komunikacji z AI. Pamiętajcie o kilku kluczowych zasadach:

- Precyzja: Im bardziej precyzyjna podpowiedź, tym lepsza odpowiedź.

- Kontekst: Zawsze podawajcie kontekst, aby model mógł lepiej zrozumieć Wasze intencje.

- Iteracja: Nie bójcie się modyfikować podpowiedzi, aż uzyskacie satysfakcjonujący rezultat.

- Krytyczne myślenie: Zawsze weryfikujcie odpowiedzi modelu i nie traktujcie ich jako ostatecznej prawdy. AI to narzędzie, a nie wyrocznia.

- Etyka: Korzystajcie z AI w sposób odpowiedzialny i etyczny.

Pamiętaj, że bycie interdyscyplinarnym badaczem w dzisiejszych czasach oznacza również umiejętność korzystania z najnowszych technologii. Inżynieria podpowiedzi jest jedną z tych umiejętności, które otwierają drzwi do efektywniejszej, a także ciekawszej pracy naukowej.

Powodzenia!